2023年5月16日,实验室两篇论文被KDD 2023会议接收。KDD会议的全称是ACM SIGKDD International Conference on Knowledge Discovery and Data Mining,是数据挖掘领域的CCF-A类会议。KDD 2023将于2023年8月6日至8月10日在美国加州长滩举办。两篇论文的信息概要如下:

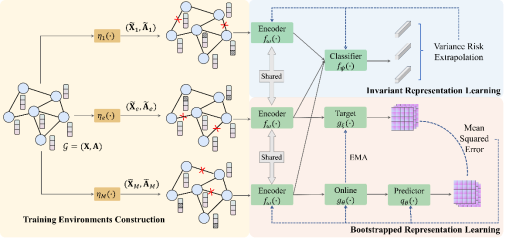

1. FLOOD: A Flexible Invariant Learning Framework for Out-of-Distribution Generalization on Graphs. (Yang Liu, Xiang Ao, Fuli Feng, Yunshan Ma, Kuan Li, Tat-Seng Chua and Qing He)

图神经网络在各个领域取得了显著的成功,但多数成功应用的假设是训练图数据与测试图数据服从相同分布,当训练集和测试集之间存在分布偏移时,在训练图上训练得到的图神经网络模型可能无法很好地泛化到测试图上,针对这种现象,本论文研究图数据的分布外泛化问题。已有的分布外泛化解决方案基于不变性原则训练模型,即在多个环境中寻找不变量进行学习;然而,不变学习后图编码器是固定的,无法灵活地根据目标分布的变化进行调整。为了解决分布外泛化中图神经网络的灵活性问题,论文提出了一种灵活的不变图表示学习框架(Flexible invariant Learning framework for Out-Of-Distribution generalization on graphs,简称FLOOD),包括环境无关的不变表示学习、分布感知的自助表示学习和分布偏移自适应的测试时训练三个模块。环境无关的不变表示学习通过图数据增强构建多个训练环境,并在风险外推的准则下学习节点的不变表示;分布感知的自助表示学习以一种自监督的方式与不变表示学习共享图编码器进行训练;在测试阶段,共享编码器可以根据目标分布灵活地更新参数以使模型获得最佳的泛化效果。在直推式和归纳式节点分类任务上的实验结果表明,FLOOD在图数据分布外泛化问题中始终优于其他对比方法,可以灵活地适应到目标分布,实现分布外泛化。

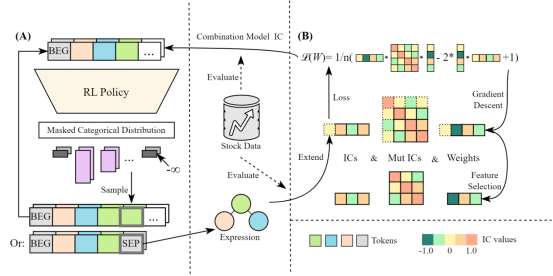

2. Generating Synergistic Formulaic Alpha Collections via Reinforcement Learning (Shuo Yu, Hongyan Xue, Xiang Ao, Feiyang Pan, Jia He, Dandan Tu, Qing He)

在量化交易领域,通常的做法是将原始的历史股票数据转化为市场趋势的指示信号,此类信号称为alpha因子。公式形式的因子更可解释,因此广受关注风险的从业者的青睐。在实际场景中,为获得更好的预测精度,一组公式化因子通常一起使用,因此需要找到能协同工作的公式化因子集。然而,大多数传统的因子生成器都是逐个挖掘的,而忽略了这些因子稍后需要组合的问题。本研究提出了一种新的协同因子集合挖掘框架,直接使用下游组合模型的性能来优化因子生成器。本文提出的框架还利用强化学习的强大探索能力来更好地探索公式因子的广阔搜索空间,将强化学习中的回报设定为新因子对组合模型性能的贡献,由此驱动生成器挖掘更好的因子改进当前因子集。在真实股市数据上的实验评估证明了文中股价预测框架的有效性和效率。并且,投资模拟结果表明本框架与以前的方法相比能够获得更高的回报。

附件: